Imagina este escenario: Estás a punto de presentar un proyecto de gran importancia en tu trabajo y has delegado el informe ejecutivo a la Inteligencia Artificial, minutos antes de presentarlo empiezas a leerlo y te das cuenta que los datos y las métricas en las que te está basando no existen. La inteligencia artificial se los inventó.

En este artículo, te explicaré qué son las “alucinaciones”, por qué ocurren y cómo puedes fundamentar tu toma de decisiones adaptando la IA a tu realidad.

¿Qué son las alucinaciones en Inteligencia Artificial?

Soy de los que piensa que para solucionar un problema, primero debemos conocer el origen del mismo. Primero que nada, te explicaré qué son las alucinaciones en Inteligencia Artificial.

Una alucinación algorítmica ocurre cuando la IA genera una respuesta con fluidez y seguridad, pero que es totalmente falsa. Lo cierto es que, los Grandes Modelos de Lenguajes (LLM) no comprenden el mundo real y mucho menos el nuestro. Su única función es predecir la siguiente palabra basándose en cálculos probabilísticos. Esto es diferente a un error humano.

Un profesional duda cuando no sabe algo. La IA, en cambio, disfraza su ignorancia con convicción. Aquí es donde debemos diferenciar los tipos de fallos para aplicar la gestión de riesgos adecuada:

- Alucinación o Confabulación: La IA inventa métricas, leyes o datos para «rellenar» vacíos de conocimiento, extrapolando probabilidades.

- Error de Decodificación: Ocurre un fallo en el procesamiento y la máquina devuelve texto ininteligible o repite palabras en bucle.

- Sesgo Algorítmico (Input Bias): El modelo replica y amplifica prejuicios históricos.

En este punto es importante destacar que el verdadero peligro en tu trabajo radica en la alucinación extrínseca de los modelos. Es decir, cuando el modelo agrega información que no estaba en tus documentos ó la información que le has proporcionado al inicio.

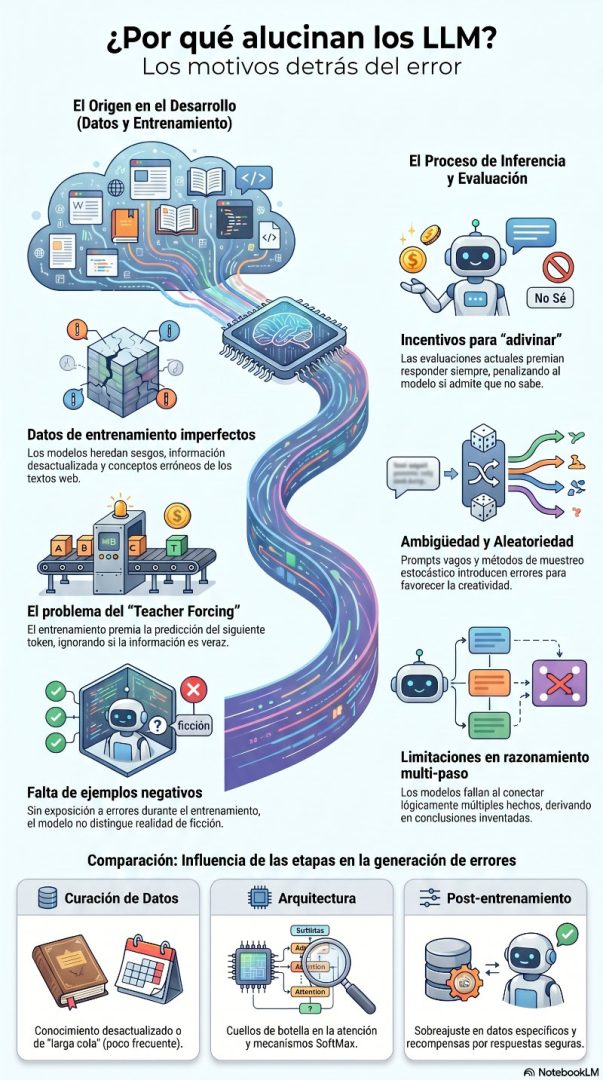

¿Por qué ocurren las alucinaciones y qué impacto tienen?

Las alucinaciones en el uso de la Inteligencia Artificial son el resultado predecible de cómo están construidas y auditadas estas tecnologías.

Existen tres causas técnicas fundamentales:

- Sobreajuste (Overfitting): Ocurre cuando un modelo de Inteligencia Artificial se entrena de forma exclusiva con un conjunto de datos específicos volviéndose excesivamente sensible a los patrones y detalles exactos. Por lo tanto, cuando le haces una pregunta ligeramente distinta, se niega a fracasar y reconstruye la realidad inventando vínculos que no existen.

- Conocimiento de Cola Larga (long-tail knowledge): Este tipo de alucinación se produce cuando la IA carece de datos de entrenamiento suficientes sobre un tema específico, a menudo raro o de nicho (la «cola larga»). Al no disponer de la información necesaria, es probable que la IA invente o genere una respuesta incorrecta, en lugar de reconocer su desconocimiento.

- El incentivo a la adivinanza: ocurre cuando los sistemas que entrenan y evalúan a la Inteligencia Artificial (IA) la premian por dar cualquier respuesta, en lugar de enseñarle a admitir que no sabe algo o que tiene dudas

Si tienes curiosidad y deseas saber más de porqué ocurren las alucinaciones en los LLM (Large Language Models), te comparto el siguiente paper: Why Language Models Hallucinatepublicado por OpenAI.

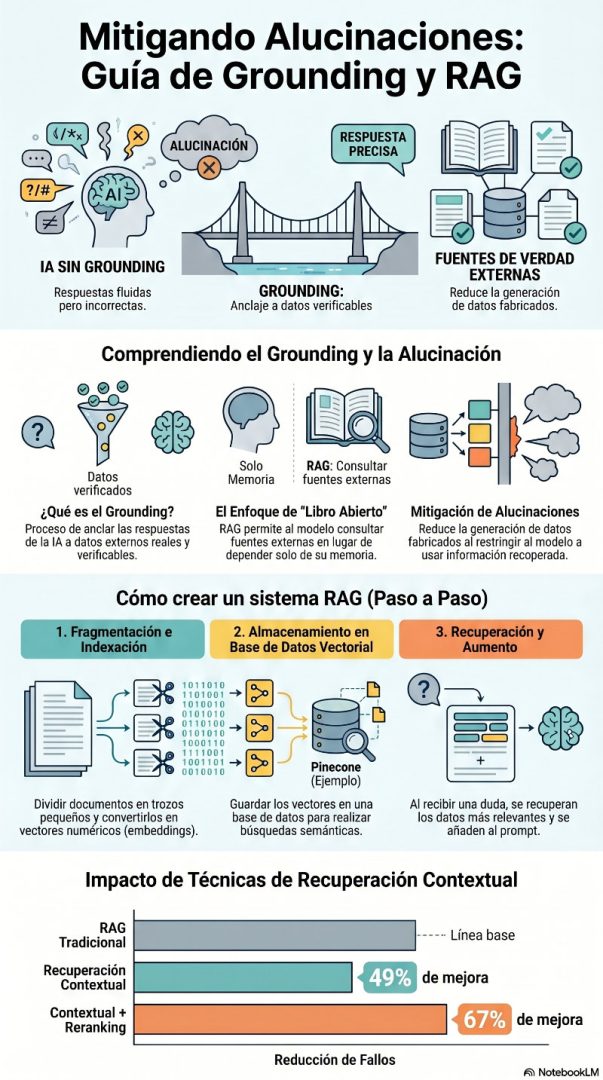

Técnicas de Grounding (Anclaje)

Para convertir la IA de una herramienta experimental a un activo, los estrategas utilizan una técnica arquitectónica llamada Grounding o Anclaje.

¿El principio? Toda recomendación que emita la máquina debe estar atada y verificada contra un documento propio de nuestro sistema de información o de la empresa en la cual trabajamos. De esta forma, evitamos que la Inteligencia Artificial suponga la respuesta (Suposición cero).

¿Qué es el Grounding o RAG?

La forma más robusta de hacer Grounding es a través de RAG (Generación Aumentada por Recuperación). Cuando creamos y empleamos un RAG curado y auditado en lugar de dejar que la IA consulte su inmensa «memoria» general, interviene el proceso en tres pasos:

- Recuperación: Transforma todos tus PDF, contratos y correos en vectores matemáticos. Cuando haces una pregunta, el sistema busca exactamente el fragmento de texto donde está la respuesta.

- Aumento: Inyecta ese texto verídico directamente en tu orden (prompt) original.

- Generación Anclada: La IA es forzada, mediante instrucciones invisibles, a responder exclusivamente con el documento que se le entregó. Se convierte en un sintetizador ultrapreciso de tu verdad corporativa.

Cómo crear una RAG de información en el entorno de Google y Gemini

Hasta hace poco, la implementación y el mantenimiento de un sistema de Generación Aumentada por Recuperación (RAG) era costoso y dependiente de arquitectos de nube. Sin embargo, Google ha simplificado este proceso, integrando el anclaje de datos directamente en sus herramientas de uso diario: Google Workspace y NotebookLM.

Al disponer de un sistema de almacenamiento y una estructura definida, es posible consolidar toda la información relevante de proyectos, áreas de trabajo, recursos y archivos. Esto se convierte en el contexto que alimenta los Modelos de Lenguaje Grandes (LLMs).

En mi caso particular, he elegido el ecosistema de Gemini, dado que mi experiencia de más de diez años de trabajo y almacenamiento de documentos se centra en Google Drive.

NotebookLM: Contexto de Alta Precisión

Actualmente, NotebookLM permite compilar hasta 300 fuentes de información en «cuadernos» (Para el plan PRO) que actúan como contexto directo para las interacciones con Gemini. Esta orquestación de un proceso RAG de altísima precisión se logra en milisegundos. Como resultado, Gemini extrae los datos y ancla su respuesta exclusivamente a la documentación proporcionada, garantizando la reducción de contaminación externa y alucinaciones.

Llegado a este punto seguramente te preocupa que tus datos personales o los datos corporativos alimenten modelos de inteligencia artificial públicos. Es relevante destacar que los planes empresariales de Google Workspace implementan un modelo de protección de la información. Además, es importante señalar que otros competidores como los planes empresariales de ChatGPT y Claude también ofrecen garantías de seguridad al no utilizar los datos organizacionales para el entrenamiento de sus modelos públicos.

La supervisión humana siempre tiene la última palabra

La llegada de la IA ha cambiado nuestro proceso de trabajo y la forma como operamos; pero lo cierto es que la Inteligencia Artificial sin la supervisión humana es un gran riesgo. Por lo tanto, renunciar a la validación de un analista humano en favor de un modelo probabilístico es un error.

Gracias a la técnica de Grounding y RAG de información, podemos mitigar las alucinaciones de la Inteligencia Artificial y protegernos contra los datos inventados, convirtiendo una tecnología que alucina en un instrumento de altísima rentabilidad.

La Inteligencia Artificial es un catalizador, no un reemplazo. La IA no tiene instinto, puede ejecutar análisis masivos, pero nosotros marcamos la diferencia con nuestro criterio y capacidad de resolver problemas. El discernimiento contextual y el rigor intelectual son tareas exclusivas de nosotros los humanos.